Ancho de banda vs latencia: cómo entender la diferencia. Cuando se trata del rendimiento de la red, uno de los factores que surge constantemente tanto para los consumidores como para las empresas es la velocidad. Todos quieren conexiones más rápidas y un mejor rendimiento. Los proveedores de servicios de Internet a menudo están ansiosos por entrar y ofrecer un mayor ancho de banda como una cura evidente para cada problema. Después de todo, más ancho de banda obviamente se traduce en más velocidad, ¿verdad?

Bueno… no necesariamente. La velocidad de la red se ve afectada por una serie de factores además del ancho de banda. El rendimiento y la latencia a menudo juegan el mismo papel, si no más, en el rendimiento. Esto es lo que todos deben saber sobre el ancho de banda frente a la latencia.

Tabla de contenidos

Ancho de banda definido

Aunque las personas a menudo equiparan el ancho de banda con la velocidad de la red, el término en realidad no se relaciona directamente con la velocidad. El ancho de banda es una medida de la cantidad de datos que se pueden transferir a través de una banda de comunicación durante un período de tiempo fijo (generalmente un segundo). Como su nombre indica, describe el «ancho» de la «banda» de comunicación. Las primeras mediciones se expresaron en bits por segundo (bps), pero las redes modernas tienen una capacidad mucho mayor. Estas conexiones se miden en megabits (Mbps) o incluso gigabits por segundo (Gbps).

Parte de la confusión sobre la velocidad de la red proviene de la similitud entre un bit, que se usa para medir la velocidad de transferencia de datos, y un byte, que se usa para medir el almacenamiento de datos. Los bits se abrevian con una minúscula «b» mientras que los bytes se abrevian con una mayúscula «B». Hay ocho bits contenidos en cada byte. Una conexión de red con un ancho de banda de 20 Mbps, entonces, no podrá descargar un archivo de 20 MB en un segundo. Tomará ocho segundos porque el archivo de 20 megabytes contiene 160 megabits.

Transferencia mensual de datos y rendimiento

El ancho de banda a menudo se confunde con otros dos términos clave de transferencia de datos: transferencia mensual de datos y rendimiento. La transferencia mensual de datos se refiere a la cantidad de datos que viaja a través de una red en el transcurso de un mes. Un ejemplo útil para demostrar esta relación es una longitud de tubería de agua. El ancho de banda es análogo al ancho de la tubería real porque determina la cantidad de agua que puede pasar a la vez. La transferencia mensual de datos se referiría a la cantidad de agua vertida a través de la tubería.

El rendimiento, por otro lado, mide la cantidad de datos que puede procesar un sistema informático en una red. Si un dispositivo tiene un rendimiento bajo, ninguna cantidad de ancho de banda podrá ayudarlo a enviar y recibir datos más rápido. Esta es la razón por la cual algunos consumidores se frustran cuando sus conexiones de alto ancho de banda no ofrecen un mejor rendimiento. El problema no es con su conexión de red, sino con el hardware que carece de la potencia de procesamiento para aprovecharlo.

La diferencia entre ancho de banda y latencia

La diferencia entre ancho de banda y latencia

Si bien el ancho de banda ciertamente puede afectar la velocidad de la red, cuando la mayoría de las personas se quejan de retraso o almacenamiento en búfer, a menudo hablan de problemas asociados con la latencia. Cuando se envía un paquete de datos de una ubicación a otra, aún necesita recorrer físicamente la distancia a través de cables o alguna forma de frecuencia inalámbrica .

Sin embargo, incluso los cables de fibra óptica más rápidos, los datos aún están limitados por las leyes de la física y nunca podrán superar la velocidad de la luz. Eso significa que siempre habrá un límite superior para la rapidez con que los datos pueden moverse a través de una red, incluso en condiciones ideales. Y las condiciones rara vez son ideales. Si bien la mayor parte de la transmisión puede utilizar una infraestructura de red rápida, atraviesa la » última milla». Antes de llegar a cualquiera de los extremos de la conexión, a menudo implica una mezcla de conexiones más lentas que reducen significativamente la velocidad.

La latencia mide el retraso entre el momento en que se envía un paquete de datos y el momento en que se recibe y procesa. En los primeros días de las conexiones a Internet, la latencia rara vez era un problema porque las limitaciones de ancho de banda ocultaban la lentitud con la que viajaban los datos a través de las redes. El retraso entre el envío de una solicitud fue generalmente mucho menor que la cantidad de datos que podrían moverse a través de las conexiones, por lo que la latencia era casi invisible.

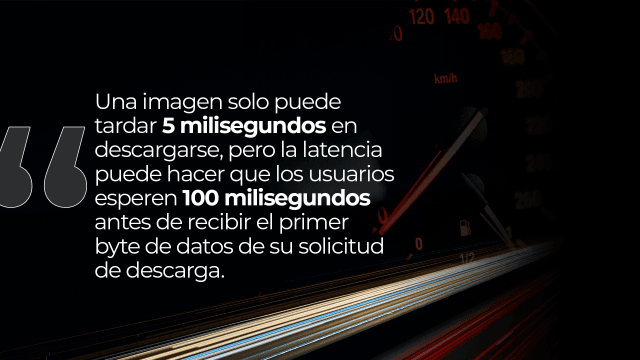

Sin embargo, como las conexiones de mayor ancho de banda han aumentado considerablemente las velocidades de descarga, la latencia es mucho más notable. Por ejemplo, una imagen solo puede tardar 5 milisegundos en descargarse, pero la latencia puede hacer que los usuarios esperen 100 milisegundos antes de recibir el primer byte de datos de su solicitud de descarga.

Cómo reducir la latencia de red

El marco de cómputo Edge ofrece una solución única a los desafíos que presenta la latencia y puede ayudar a las empresas a maximizar las inversiones que han realizado para aumentar el ancho de banda de su red. Mediante el uso de una combinación de dispositivos de Internet de las cosas (IoT) y centros de datos periféricos ubicados geográficamente en mercados emergentes clave , las empresas pueden llevar más de su carga de procesamiento al límite de su red donde se encuentran sus usuarios finales y también ofrecen conexiones directas dentro de un entorno del centro de datos .

Si bien los dispositivos IoT pueden procesar una gran cantidad de datos localmente, los centros de datos periféricos pueden atender necesidades de procesamiento más exigentes sin tener que pasar datos a instalaciones de hiperescala más grandes ubicadas lejos.

Cuando se implementa junto con una red de gran ancho de banda, la arquitectura de computación de borde tiene el potencial de mejorar en gran medida el rendimiento y ayudar a las empresas a proporcionar servicios mucho mejores a sus clientes.

¿El ancho de banda afecta la latencia?

El ancho de banda puede no ser el principal determinante de la velocidad para muchos clientes, pero es importante comprender cómo afecta el rendimiento de la red junto con factores como la latencia y el rendimiento. La relación puede no ser directa, pero su interacción tiene una influencia importante en la velocidad. Si una red está plagada de conexiones de alta latencia, ninguna cantidad de ancho de banda lo ayudará a transferir datos. Del mismo modo, reducir la latencia con las implementaciones de cómputo de borde puede no ofrecer un rendimiento mejorado si el ancho de banda y el rendimiento siguen siendo bajos. Al trabajar para mejorar todos estos factores, las empresas pueden ofrecer servicios mejores y más rápidos a sus clientes.

Leer también:Ancho de banda de colocación, colocation, housing; facturación; ¿Qué es la facturación 95% percentil de ancho de banda y cómo se calcula?; ¿Edge Computing es una buena idea?

More from Hosting

Colocation vs. Cloud: ¿Qué es lo mejor para tu negocio?

Colocation vs. Cloud: ¿Qué es lo mejor para tu negocio? En la era digital actual, donde la tecnología juega un …

¿Por qué usar DRaaS? Beneficios, razones para usarlo

DRaaS (recuperación ante desastres como servicio) es un modelo de servicio de informática de nube que permite a las organizaciones …

Diferencias entre BaaS y DRaaS

Diferencias entre BaaS y DRaaS. BaaS y DRaaS son dos tipos de servicios en la nube que ofrecen soluciones de …